要设置LookWorldPro的去重规则,核心思路是先定义粒度、阈值和处理策略,并在后台按项目逐步应用。具体做法包括设定相似性阈值、指定去重粒度、选择比对范围、配置处理动作、记录日志与度量,并定期复核效果。同时应提供可视化诊断,方便快速辨别误判来源和改进点。还要设立日志留存与版本回滚机制。以便追溯。

LookWorldPro去重规则的核心理念

用费曼法来讲,去重就像在一堆翻译版本里找重复的“句子片段”,但我们需要把它做成可操作的规则。先把要比较的内容分成粒度较小的单位,再用一个简单的尺子衡量它们有多像。像素级别的像或句子级别的相似性都需要被考虑,但最终的规则要能自动做决定:要不要把这两段算作同一条历史、还是只保留其中一个版本,或者合并成一个新的版本。整套规则还要能给出改动的日志、统计指标和回滚能力,这样在出现错误时可以快速纠正。简言之,去重不是单纯“找相同”,而是把相似度、上下文、语言风格等多维信息综合起来,形成一个可执行的工作流。

粒度的选择与影响

粒度决定了去重的敏感度。你可以把文本分成以下几个层级:文档级、段落级、句子级、短文本片段。粒度越粗,比较速度越快,误判越可能增加;粒度越细,准确性越高,但算力和存储需求也越大。在实际应用中,通常采用分层策略:先对文档级进行快速筛选,筛出高度相似的候选对,再在候选对内进行句子级或短文本级的逐条比对。这样既省力又不失精度。

相似性阈值的设定

相似性阈值是决定两段内容是否走去重流程的关键数字。常见做法是设定一个全局阈值和一个局部阈值的组合。例如,若全文相似度超过0.85且句内某关键术语重合度高,则判定为重复;若相似度处于0.70-0.85之间,可以将其标记为“待审”并进入人工复核。这种分级方法能够兼顾全局一致性和局部差异。实际落地时,建议提供阈值的动态调优机制,让数据科学家和翻译团队通过试错快速找到最佳点位。

匹配策略与比对范围

匹配策略包括直接文本比对、基于向量的语义相似性、以及术语表/记忆库的辅助比对。直接文本比对适用于高保真场景,能稳定识别完全重复的片段;向量语义比对有利于跨语言和同义表达的识别,但需要更强的计算资源。比对范围要灵活设置:项目内、全局历史库、乃至跨平台的翻译记忆库。一个好的策略是把全局历史库作为候选池,结合当前项目的上下文来做最终决策。

去重动作:替换、合并、跳过

当规则判定存在重复时,系统需要选择合适的处理动作。替换通常用于更新历史版本,保留最新质量的译文;合并适用于少量重复但包含互补信息的片段,将两者整合成一个新的版本;跳过则用于完全重复或不影响理解的情况,避免冗余生成。不同场景也可以组合使用,例如对同义表达进行“合并”,对极端重复进行“替换”或“跳过”。

日志、度量与回滚

有效的去重规则需要可观测性。日志应记录触发去重的片段、阈值、匹配分数、所采取的动作以及后续的人工复核结果。关键度量通常包含准确率、召回率、F1 值、以及去重带来的版本大小变化、处理时间等。为保障安全,必须提供版本回滚机制,一旦新规则引发质量下降,可以快速回滚到先前稳定版本,避免影响实际用户体验。

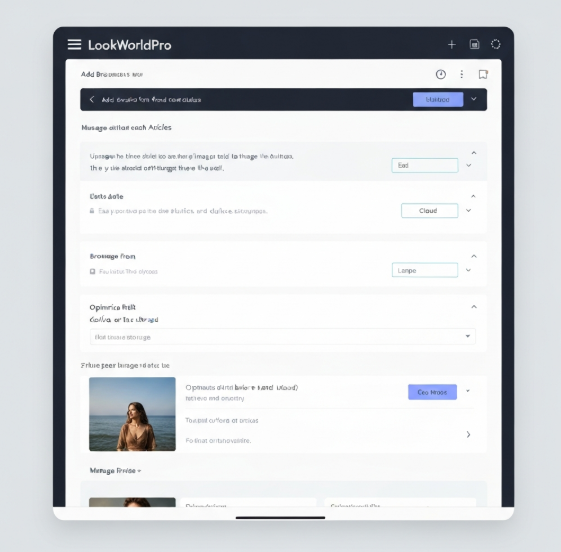

实操配置指南(LookWorldPro)

下面给出一个实操路线,帮助你把上述理念落到实际操作中。方法以步骤化为主,便于团队协同与迭代。

- 步骤一:进入去重设置界面,确认你拥有管理员权限,进入“去重规则”模块,创建一个新规则集或编辑现有集合。

- 步骤二:定义粒度层级,根据应用场景选择文档、段落、句子或短文本的粒度;必要时开启分层策略,确保先筛选、再深入。

- 步骤三:设定相似性阈值,建议从全局阈值0.85起步,结合局部阈值0.75-0.90进行微调,设置待审阈值以便人工参与。

- 步骤四:选择比对范围,决定是否跨项目、跨平台、是否包含翻译记忆库,设置候选池的优先级。

- 步骤五:配置去重动作,结合替换、合并、跳过的策略,给出默认动作,并为例外情况设定人工干预入口。

- 步骤六:启用日志与度量,开启详细日志、设定保留周期、配置关键指标的可视化仪表盘,确保可追溯性。

- 步骤七:测试与迭代,对历史数据和模拟数据进行回放测试,观察误判来源,逐步调整阈值与粒度。

- 步骤八:监控与回滚,上线后持续监控去重效果,遇到异常时可快速回滚并重新评估规则。

常见误区与纠正

- 误区一:越严格越好。其实过高的阈值会丢失潜在的有价值信息,应该通过分层阈值和人工复核来平衡。

- 误区二:粒度固定,永不改变。现实中文本风格、领域差异会影响去重效果,应定期回顾并调整粒度。

- 误区三:记忆库越大越好。记忆库过大会引入噪声,需对记忆库进行清洗、去重和版本控制。

- 误区四:只看“是否重复”,忽略上下文。应把语境、术语表、领域特定表达纳入评估。

参数表:典型设置选项

| 粒度选项 | 文档级、段落级、句子级、片段级 |

| 全局阈值 | 0.75 – 0.95(步进调优) |

| 局部阈值 | 0.65 – 0.85(按领域设定) |

| 比对范围 | 项目内、全局历史、跨平台记忆库 |

| 处理动作 | 替换、合并、跳过、人工干预 |

| 日志保留周期 | 3-12 个月(可配置) |

示例场景与落地要点

设想你在跨国电商场景中运营多语言商品描述。初始阶段,可以采用粒度从句子级到段落级的分层策略,先用全局阈值0.85进行快速筛选,候选对进入向量语义比对阶段,若相似度高于0.9且关键术语高度重合,则触发替换动作,保留语气与商品信息的准确性。对于风格相近但领域特异的描述,可能需要增设“待审”队列,交由人工复核。通过持续监控,逐步把阈值、粒度和比对策略调整到一个稳定区间。这样,系统能稳定地减少重复内容,同时保持信息丰富性。

文献与参考

- 费曼写作法原理与教学应用(Feynman Technique)

- 跨语言去重与翻译记忆的研究综述

- 文本去重在工业场景中的实践指南